人工智能OPC(一人公司)是指在人工智能技术的协同支持下,个人创业者可独立完成从产品设计、技术研发、产品制造到市场投放、用户运营、客户服务等全链路业务...

2026-06-05 39 人工智能AI行业报告

我们认为大模型的出现有望带动AI服务器需求: 我们认为除了对低延迟低功耗算力的性能需求,在服务器的种类上也产生了多样化、细 分化的场景应用需求。各行业与人工智能技术的深度结合及应用场景的不断成熟与落地,使人工智能芯片朝着多元化的方向发展,为了 迎合芯片的多元化,服务器的类型也将越来越丰富,并适用越来越多的行业应用场景。根据IDC的数据,在2021年的统计,预计到 2025年中国加速服务器市场规模将达到108.6亿美元,且2023年仍处于中高速增长期,增长率约为20%。 AI大模型对算力的需求分别来自训练和推理两个环节。1)训练环节:通过标记过的数据来训练出一个复杂的神经网络模型,使其能够 适应特定的功能,模型具有一定的通用性,以便完成各种各样的学习任务。该环节需要处理海量的数据,注重绝对的计算能力。2)推 理环节:利用训练好的模型,使用新数据推理出各种结论。借助神经网络模型进行运算,利用输入的新数据来一次性获得正确结论的过 程。该环节对算力要求比训练环节略低,但注重综合指标,单位能耗算力、时延、成本等都要考虑。

服务器价值凸显:计算机的一种,它比普通计算机运行更快、负载更高、价格更贵,主要用于在网络中为其它客户机提供计算或者应用 服务。服务器具有高速的CPU运算能力、长时间的可靠运行、强大的I/O外部数据吞吐能力以及更好的扩展性。服务器一般具备承担响应 服务请求、承担服务、保障服务的能力。其内部的结构与普通的计算机相差不大,主要包括如:CPU、硬盘、内存,系统、系统总线等, 但相较于PC端需考虑几方面,例如可拓展性、易使用性、可用性和易管理性。 服务器架构随负载量扩张而不断优化: 服务器架构经历了从传统单一模式到集群模式,再到分布式架构的优化过程。传统单一模式,服 务器诞生初期将所有功能汇集在同一个系统,缺点为不便于维护、横向拓展性不佳;因此集群模式诞生,这种集群模式将同一项目放在 多个服务器上,有效缓解用户访问量大的压力,但由于各个服务器间功能重复却缺乏协同,系统维护成本仍然较高,且增加了用户重复 登陆问题,因此服务器架构进化到分布式模式。在分布式架构中,整个系统按照不同功能拆分为多个单一功能的子模块,每个模块被放 到不同服务器中相互协作,共同组成服务器网络,能够有效解决功能耦合度高等问题且代码复用性高。

标签: 人工智能AI行业报告

相关文章

人工智能OPC(一人公司)是指在人工智能技术的协同支持下,个人创业者可独立完成从产品设计、技术研发、产品制造到市场投放、用户运营、客户服务等全链路业务...

2026-06-05 39 人工智能AI行业报告

本报告基于自主研发的“中国具身智能产业发展指数(EAII)”评价体系, 对 2025-2026 年度中国具身智能产业发展水平进行系统性评估。评估显示,...

2026-06-03 30 人工智能AI行业报告

综合业界实践与技术白皮书,一个真正的 AI-Native 应用,其设计与构建应系统性地体现 AI First 的核心理念,并在以下六个维度上达到深度融...

2026-06-03 61 人工智能AI行业报告

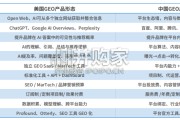

在美国,AI搜索正从传统搜索的补充演变为用户的默认信息入口,并深度介入从认知、比较到决策的全过程,使品牌是否被AI理解与提及直接影响用户选择。在此基础...

2026-06-01 47 人工智能AI行业报告

OpenClaw(前身为ClawdBot/Moltbot),由奥地利开发者打造,是一个开源的本地优先(Local-First)AI Agent框架。在...

2026-06-01 39 人工智能AI行业报告

最新留言