[Download]资源名称:摩根斯坦利报告:人工智能的力量:灵活算力——AI增长的下一个浪潮(英文,60页)...

2026-05-11 18 人工智能AI行业报告

Gopher 是Google Deepmind在2021年12月份提出的,该模 型共有6个版本,参数量从4400万到2800亿。 Gopher是在 MassiveText数据集上训练得到,该数据集是一个多源大规模英 语文本数据集,来源主要包括:网页、书籍、新闻和代码,总共 包含23.5亿的文档,约等于10.5TB的文本。 Gopher模型在多个TPU节点上进行训练,每个节点包含1024个 TPUv3芯片,节点间采用数据并行和张量并行,由于TPUv3具有 快速的跨芯片通信,因此数据和模型并行开销很低。在训练的过 程中对梯度进行裁剪,防止梯度消失或者爆炸,保持训练稳定性。 Gopher在152个任务上进行了评估,涉及数学、常识、逻辑推 理、通用知识、科学理解、伦理和阅读理解,以及传统的语义建 模基准等多个方面。

RT-2 建立在视觉 - 语言模型(VLM)的基础上,又创造了一种新的概念:视觉 - 语言 - 动作(VLA)模型,它可以从网络和机器人数据中 进行学习,并将这些知识转化为机器人可以控制的通用指令。 7月28日,Google DeepMind宣布其通过以训练AI聊天机器人的方式训练一款机器人控制模型RT-2,相当于机器人版本的ChatGPT。 Google DeepMind通过对该模型进行视觉识别和语言识别上的训练,教会了机器人更好的识别物品和理解人类用自然语言发出的命令。 Google DeepMind团队通过直接训练开放词汇视觉问答和视觉对话设计,据Google DeepMind团队介绍,他们在互联网数据上训练了多 达55B参数的模型,对6千个机器人进行评估,最后发现RT-2模型能够显著提高机器人场景和指令的泛化能力。 从PaLM-E到以RT-2为代表机器人模型进化迭代,我们认为有望重塑机器人智能化产业链,改善产业格局,助力机器人在交互能力、规划控 制能力、泛化能力、感知能力等多方面极大提升。

标签: 人工智能AI行业报告

相关文章

[Download]资源名称:摩根斯坦利报告:人工智能的力量:灵活算力——AI增长的下一个浪潮(英文,60页)...

2026-05-11 18 人工智能AI行业报告

[Download]资源名称:AI原生组织研究报告:OpenClaw推动组织形态重塑(47页)...

2026-05-08 39 人工智能AI行业报告

面对 AI 技术的狂飙突进,站在生产力跃升的拐点,我们更愿抛出一个积极的论断:2026 年,大模型不仅不会取代优秀的营销团队, 反而会成为企业构建核心...

2026-05-08 45 人工智能AI行业报告

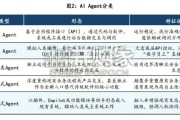

AI Agent分类体系主要围绕技术实现路径与生态影响模式展开。按技术路径,分为 API Agent与GUI Agent两类。API Agent依托标...

2026-05-07 46 人工智能AI行业报告

“十五五”时期(2026-2030 年)是我国建设社会主义文化强国的关键攻坚期,也是数字文化产业实现高质量发展、 构建全球竞争力的战略窗口期。围绕 国...

2026-05-06 34 人工智能AI行业报告

最新留言