[Download]资源名称:AI原生组织研究报告:OpenClaw推动组织形态重塑(47页)...

2026-05-08 13 人工智能AI行业报告

大模型的实现需要十分强大的算力来支持训练过程和推理过程。根据OPENAI数据,训练GPT-3 175B的模型,需要的算 力高达3640 PF-days(即以1PetaFLOP/s的效率要跑3640天)。2018年以来,大模型的参数量级已达到数千亿参数的 量级规模,对算力的需求将呈现指数级增长。根据《COMPUTE TRENDS ACROSS THREE ERAS OF MACHINE LEARNING》研究结果,大模型时代,算力翻倍的需求时间 是9.9个月。AI芯片的性能提升成为决定大模型从理论实践到大规模应用的关键要素。 在供给端,AI芯片厂商推出了性能越来越强的新产品来应对人工智能发展的算力需求。以英伟达为例,2020年,英 伟达推出了A100 GPU芯片,相比上一代V100 GPU芯片,A100 GPU芯片性能大幅提升。针对大模型,A100 GPU芯片相 比V100 GPU芯片可提供高达3倍的训练速度。

在训练端:据报道,2020年,微软宣布与OpenAI合作,建成了一台超级计算机,专门用来在Azure公有云上训练超大规模的人工智能模型。这台为OpenAI开 发的超级计算机拥有超过28.5万个CPU核心,拥有超过1万个GPU(V100 GPU芯片)。以此规格,如果自建IDC,以A100 GPU芯片替代V100 GPU芯片,依照 A100和V100的性能换算,需要约3000个A100 GPU芯片。根据英伟达网站信息,NVIDIA DGX A100服务器搭载8块A100芯片,估算需要375台NVIDIA DGX A100 服务器,每台NVIDIA DGX A100服务器的价格为19.9万美元,则自建IDC的训练服务器的算力成本为7462.5万美元。若在云端训练,据Lambda Labs首席科学 官Chuan li介绍,拥有1750亿个参数的GPT-3单次训练成本达到460万美元。

标签: 人工智能AI行业报告

相关文章

[Download]资源名称:AI原生组织研究报告:OpenClaw推动组织形态重塑(47页)...

2026-05-08 13 人工智能AI行业报告

面对 AI 技术的狂飙突进,站在生产力跃升的拐点,我们更愿抛出一个积极的论断:2026 年,大模型不仅不会取代优秀的营销团队, 反而会成为企业构建核心...

2026-05-08 14 人工智能AI行业报告

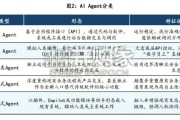

AI Agent分类体系主要围绕技术实现路径与生态影响模式展开。按技术路径,分为 API Agent与GUI Agent两类。API Agent依托标...

2026-05-07 27 人工智能AI行业报告

“十五五”时期(2026-2030 年)是我国建设社会主义文化强国的关键攻坚期,也是数字文化产业实现高质量发展、 构建全球竞争力的战略窗口期。围绕 国...

2026-05-06 26 人工智能AI行业报告

最新留言